Cognee - 정확하고 지속적인 AI 메모리

데모 . 문서 . 더 알아보기 · Discord 참여 · r/AIMemory 참여 . 커뮤니티 플러그인 & 애드온

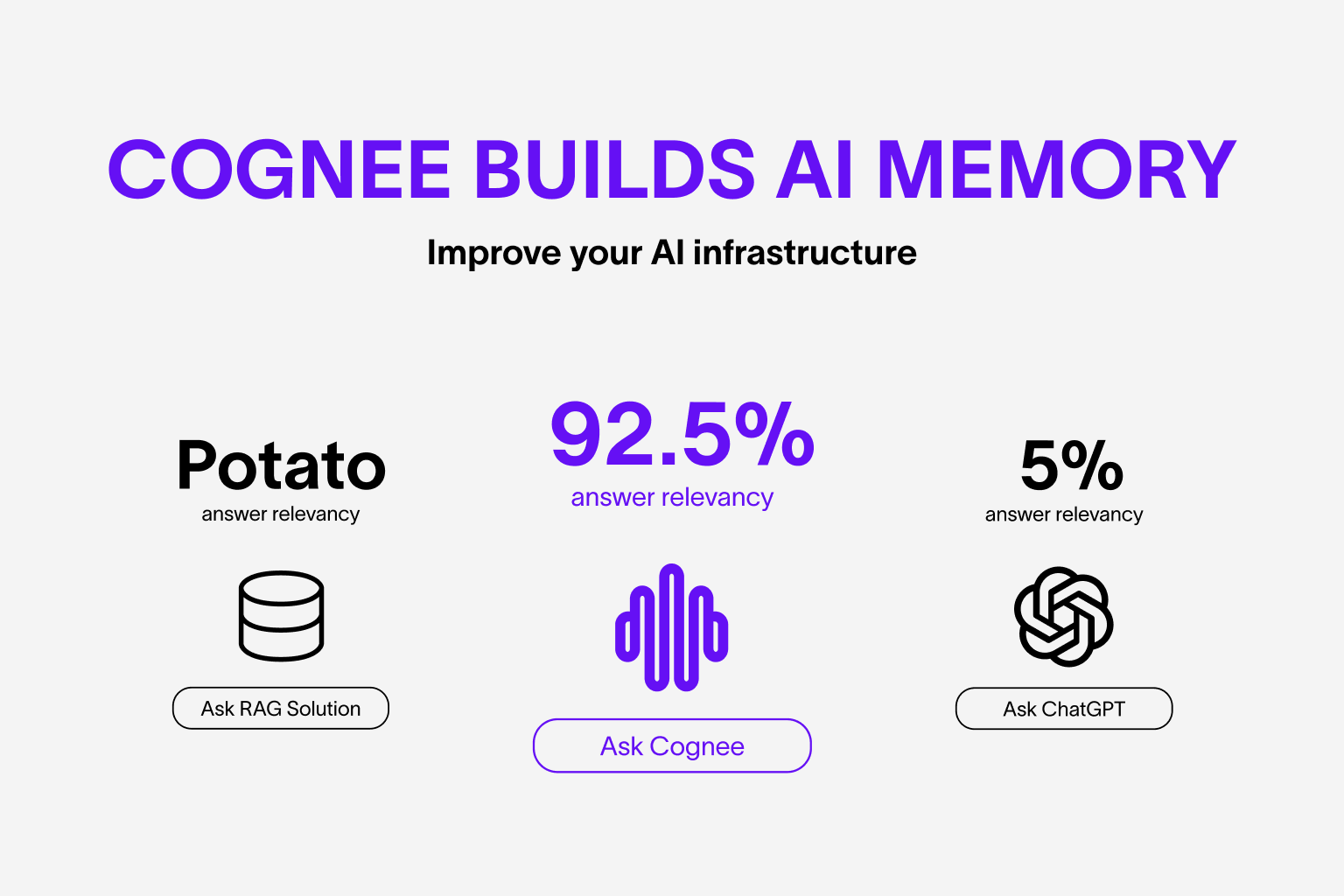

데이터를 사용하여 AI 에이전트를 위한 개인화되고 동적인 메모리를 구축하세요. Cognee를 사용하면 RAG를 확장 가능하고 모듈화된 ECL(추출[Extract], 인지화[Cognify], 로드[Load]) 파이프라인으로 대체할 수 있습니다.

🌐 사용 가능한 언어 : Deutsch | Español | Français | 日本語 | 한국어 | Português | Русский | 中文

Cognee는 원시 데이터를 에이전트를 위한 지속적이고 동적인 AI 메모리로 변환하는 오픈 소스 도구이자 플랫폼입니다. 벡터 검색과 그래프 데이터베이스를 결합하여 문서를 의미적으로 검색 가능하게 하고 관계별로 연결합니다.

Cognee는 두 가지 방식으로 사용할 수 있습니다.

- Cognee 오픈 소스 (셀프 호스팅): 기본적으로 모든 데이터를 로컬에 저장합니다.

- Cognee Cloud (관리형): 관리형 인프라에서 동일한 OSS 스택을 사용하여 더 쉽게 개발하고 프로덕션화할 수 있습니다.

- 과거 대화, 파일, 이미지, 오디오 스크립트 등 모든 유형의 데이터를 상호 연결

- 기존 RAG 시스템을 그래프와 벡터 기반의 통합 메모리 계층으로 대체

- 품질과 정밀도를 향상시키면서 개발자 노력과 인프라 비용 절감

- 30개 이상의 데이터 소스에서 데이터를 수집할 수 있는 Pythonic 데이터 파이프라인 제공

- 사용자 정의 작업, 모듈식 파이프라인, 내장 검색 엔드포인트를 통한 높은 사용자 정의 가능성 제공

- 호스팅된 웹 UI 대시보드

- 자동 버전 업데이트

- 리소스 사용량 분석

- GDPR 준수, 엔터프라이즈급 보안

자세한 내용은 Colab 튜토리얼을 확인하세요.

단 몇 줄의 코드로 Cognee를 사용해 보세요. 자세한 설정 및 구성은 Cognee 문서를 참조하세요.

- Python 3.10 ~ 3.13

pip, poetry, uv 또는 선호하는 Python 패키지 관리자를 사용하여 Cognee를 설치할 수 있습니다.

uv pip install cogneeimport os

os.environ["LLM_API_KEY"] = "YOUR OPENAI_API_KEY"또는 템플릿을 사용하여 .env 파일을 생성하세요.

다른 LLM 공급자를 통합하려면 LLM 공급자 문서를 참조하세요.

Cognee는 문서를 가져와 지식 그래프를 생성한 다음 결합된 관계를 기반으로 그래프를 쿼리합니다.

이제 최소한의 파이프라인을 실행해 보겠습니다.

import cognee

import asyncio

from pprint import pprint

async def main():

# Cognee에 텍스트 추가

await cognee.add("Cognee turns documents into AI memory.")

# 지식 그래프 생성

await cognee.cognify()

# 그래프에 메모리 알고리즘 추가

await cognee.memify()

# 지식 그래프 쿼리

results = await cognee.search("What does Cognee do?")

# 결과 표시

for result in results:

pprint(result)

if __name__ == '__main__':

asyncio.run(main())보시다시피, 출력은 이전에 Cognee에 저장한 문서에서 생성됩니다.

Cognee turns documents into AI memory.대안으로 다음 필수 명령으로 시작할 수 있습니다.

cognee-cli add "Cognee turns documents into AI memory."

cognee-cli cognify

cognee-cli search "What does Cognee do?"

cognee-cli delete --all

로컬 UI를 열려면 다음을 실행하세요.

cognee-cli -uiCognee 작동 모습 확인:

cognee_langgraph.mp4

simple_graphrag_demo.mp4

cognee-with-ollama.mp4

여러분들의 기여를 환영합니다! 여러분의 의견은 Cognee를 더 좋게 만드는 데 큰 도움이 됩니다. 시작하려면 CONTRIBUTING.md를 참조하세요.

우리는 포용적이고 존중하는 커뮤니티를 만들기 위해 노력하고 있습니다. 규칙은 규칙 문서를 확인해주세요.

최근 LLM 추론을 위한 지식 그래프 최적화에 관한 연구 논문을 발표했습니다.

@misc{markovic2025optimizinginterfaceknowledgegraphs,

title={Optimizing the Interface Between Knowledge Graphs and LLMs for Complex Reasoning},

author={Vasilije Markovic and Lazar Obradovic and Laszlo Hajdu and Jovan Pavlovic},

year={2025},

eprint={2505.24478},

archivePrefix={arXiv},

primaryClass={cs.AI},

url={https://arxiv.org/abs/2505.24478},

}